В последние две недели появилась масса докладов, в которых раскрываются подробности убийств мирных жителей американскими боевыми беспилотниками, что свидетельствует о новой волне возмущения вокруг неконтролируемого применения беспилотников Вашингтоном. Один из таких докладов был подготовлен ООН, другой – неправительственной организацией Human Rights Watch, третий – организацией Amnesty International. Возмущение международного сообщества – а также ощущение того, что Вашингтон не намерен делать применение своих дронов более прозрачным – достигло наивысшей точки во время дебатов, состоявшихся в пятницу, 25 октября, на заседании ООН.

Однако в мире возникло еще одно, параллельное движение, члены которого стремятся найти способы не дать иной и, возможно, еще более опасной технологии достичь таких же высот.

Кампания против роботов-убийц (Campaign to Stop Killer Robots) представляет собой коалицию организаций, контролирующих применение оружия, и правозащитных групп, которые с апреля 2013 года официально выступают за введение международного запрета на применение полностью автономного смертельного оружия. Такое оружие, получившее название «роботы-убийцы», способно уничтожать свою цель (то есть людей) без участия человека. В то время как современными беспилотниками управляет человек, который, находясь на значительном расстоянии, отдает им приказы, куда и когда наносить удар, полностью автономное оружие, действующее в воздухе, на земле или воде, сможет принимать решения самостоятельно.

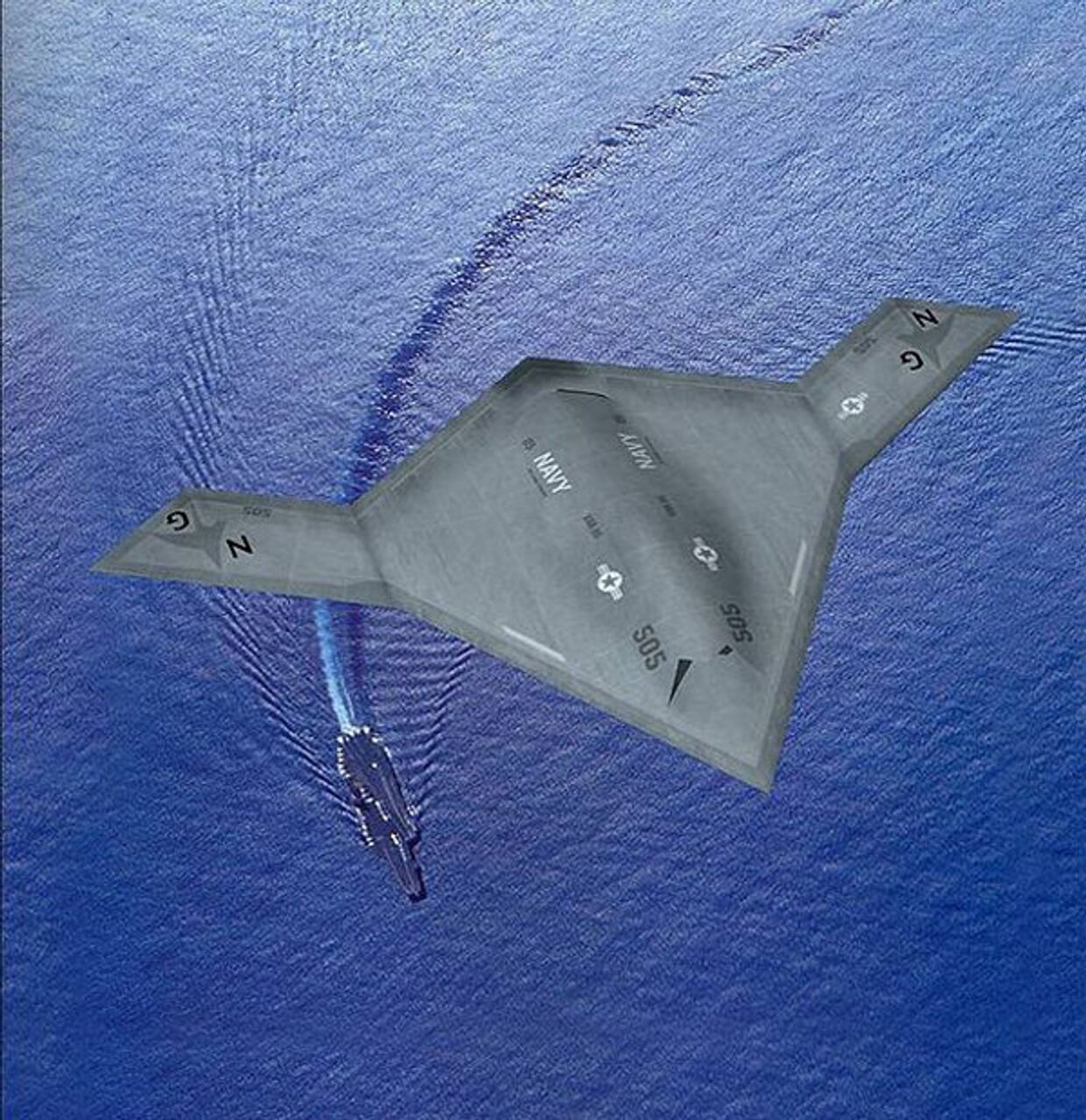

Все это похоже на научную фантастику, однако учитывая уровень развития современных военных технологий, люди смогут получить такое оружие уже в ближайшем будущем. X-47B, новейший беспилотник, принадлежащий американским ВМС, уже смог абсолютно самостоятельно взлететь и приземлиться на площадку авианосца – это считается одним из самых сложных маневров в авиации. Теперь разработчикам осталось только оснастить его ракетами. В Южной Корее несколько лет назад одна из дочерних компаний Samsung разработала стационарного робота-охранника, который способен вести наблюдение за определенной территорией, определять и стрелять в нарушителей по своему собственному усмотрению. Пока за работой этого робота следит оператор-человек.

Некоторые критики подобных технологий утверждают, что давать роботам возможность решать, будет ли человек жить или умрет, просто безнравственно и сравнимо с применением химического и ядерного оружия. Они также считают, что в электронных схемах подобных машин слишком много неопределенности. Что если робот-убийца выйдет из строя и начнет стрелять во всех без разбора? Что если его систему взломают? Сколько пройдет времени, прежде чем эти технологии попадут в руки вражеских государств и боевиков-экстремистов? И кто по закону будет нести ответственность за атаки роботов-убийц?

Ранее в октябре представители Кампании против роботов-убийц выступили с заявлением, под которым подписались 272 эксперта в области компьютерных технологий из 37 стран: все они поддержали введение запрета на развитие подобных технологий, «учитывая ограниченность и отсутствие ясности в вопросе потенциальных рисков технологий автономных боевых роботов».

«Мы обеспокоены тем, что в будущем применение роботов может разрушить границы человеческой ответственности за применение силы и ее последствия», - говорится в их заявлении.

Тем не менее, США не желают отказываться от разработки новой технологии полностью автономных роботов. В 2012 году, спустя всего несколько дней после того, как Human Rights Watch опубликовала доклад, призывающий к введению запрета, Министерство обороны США выпустило довольно противоречивую директиву, касающуюся автономного оружия, в которой говорилось всего лишь об ограничении, а не о полном отказе от его использования. Эта директива до сих пор остается единственным правительственным документом, призванным контролировать применение этой технологии. Кроме того, в настоящее время лишь в немногих странах действуют законы, ограничивающие применение роботов, что совершенно неудивительно. Сторонники полностью автономных роботов утверждают, что такое оружие в будущем станет главным средством спасения человеческих жизней.

«Хотя упреждающий запрет сейчас, возможно, кажется самым безопасным решением, он является нецелесообразным и даже опасным, - написали профессоры права Мэтью Вэксман (Matthew Waxman) и Кеннет Андерсон (Kenneth Anderson), входящие в состав Оперативной группы по вопросам национальной безопасности и права на базе института Гувера (Hoover Institution Task Force on National Security and Law). – Если цель заключается в предотвращении страданий и защите человеческих жизней, такой запрет может стать контрпродуктивным. Вполне вероятно, что машина, способная самостоятельно принимать решения – по крайней мере, в определенных контекстах – может снизить риски для мирных жителей, поскольку ее решения относительно выбора цели и ее действия по уничтожению цели будут более точными».

Оппоненты роботов-убийц указывают на то, что упреждающий запрет на применение оружия не является беспрецедентным. В 1995 году к Конвенции ООН об обычных вооружениях был добавлен протокол о запрете на применение ослепляющих лазеров. Накануне принятия этого протокола США сначала выступали против него, но затем согласились с ним, проведя оценку рисков и последствий его массового распространения, как вспоминает Стивен Гуз (Stephen Goose), руководитель отдела вооружений в Human Rights Watch. Такая перемена в убеждениях США оказалась достаточной для того, чтобы этот протокол получил необходимую поддержку в ООН.

В настоящее время представители США заявляют, что они не поддерживают введение международного запрета на применение роботов. Однако представители ООН, которые ранее на этой неделе провели встречу по вопросам потенциальной угрозы автономного оружия, а также Франции, которая станет председателем на следующем заседании участников Конвенции ООН об обычных вооружениях в ноябре, обратились с просьбой внести пункт о роботах-убийцах в программу заседания.

«Это свидетельствует о том, что правительства и вооруженные силы разных стран понимают, что такое оружие представляет собой угрозу, - считает Гуз. – То, что они решили собраться и обсудить этот вопрос, является хорошим знаком».